آیا مدل های هوش مصنوعی قدرتمند از نظر بیولوژیکی قابل قبولند؟

یک مطالعه جدید که علوم اعصاب و یادگیری ماشین را پیوند می دهد، بینش هایی را در مورد نقش بالقوه آستروسیت ها در مغز انسان ارائه می دهد.

شبکههای عصبی مصنوعی، مدلهای یادگیری ماشینی فراگیر که میتوانند برای تکمیل بسیاری از وظایف آموزش داده شوند، به این دلیل نامیده میشوند که معماری آنها از روشی که نورونهای بیولوژیکی اطلاعات را در مغز انسان پردازش میکنند الهام گرفته است.

حدود شش سال پیش، دانشمندان نوع جدیدی از مدل شبکه عصبی قدرتمندتر را کشف کردند که به عنوان ترانسفورماتور شناخته می شود. این مدلها میتوانند به عملکرد بیسابقهای دست یابند، مانند تولید متن از اعلانها با دقتی تقریباً شبیه انسان. برای مثال، یک ترانسفورماتور زیربنای سیستمهای هوش مصنوعی مانند ChatGPT و Bard است. در حالی که ترانسفورماتورها بسیار موثر هستند، اسرارآمیز نیز هستند: برخلاف سایر مدل های شبکه عصبی الهام گرفته از مغز، نحوه ساخت آنها با استفاده از اجزای بیولوژیکی مشخص نشده است.

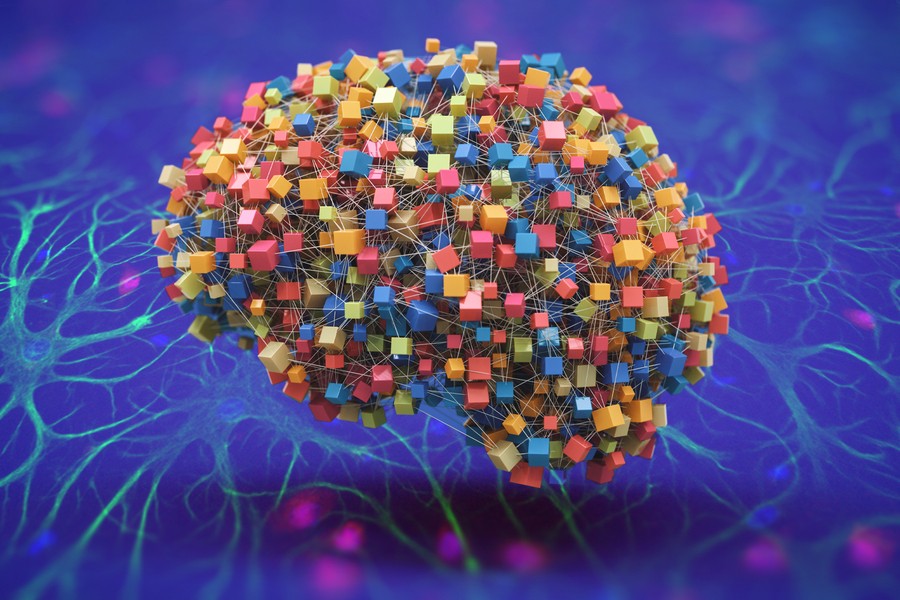

اکنون، محققان MIT، آزمایشگاه هوش مصنوعی واتسون MIT-IBM و دانشکده پزشکی هاروارد فرضیهای را ارائه کردهاند که ممکن است توضیح دهد که چگونه میتوان یک ترانسفورماتور با استفاده از عناصر بیولوژیکی در مغز ساخت. آنها پیشنهاد می کنند که یک شبکه بیولوژیکی متشکل از نورون ها و سایر سلول های مغزی به نام آستروسیت ها می تواند محاسبات هسته ای مشابه یک ترانسفورماتور را انجام دهد.

تحقیقات اخیر نشان داده است که آستروسیت ها، سلول های غیر عصبی که در مغز فراوان هستند، با نورون ها ارتباط برقرار می کنند و در برخی از فرآیندهای فیزیولوژیکی مانند تنظیم جریان خون نقش دارند. اما دانشمندان هنوز درک روشنی از کارهای محاسباتی این سلول ها ندارند.

با مطالعه جدید که این هفته در قالب دسترسی آزاد در مجموعه مقالات آکادمی ملی علوم منتشر شد، محققان نقش آستروسیت ها در مغز را از منظر محاسباتی بررسی کردند و یک مدل ریاضی ساختند که نشان می دهد چگونه می توان از آنها استفاده کرد. همراه با نورون ها، برای ساخت یک ترانسفورماتور قابل قبول بیولوژیکی.

فرضیه آنها بینش هایی را ارائه می دهد که می تواند جرقه تحقیقات علوم اعصاب آینده را در مورد نحوه عملکرد مغز انسان بزند. در عین حال، میتواند به محققان یادگیری ماشینی کمک کند تا توضیح دهند که چرا ترانسفورماتورها در مجموعهای از وظایف پیچیده بسیار موفق هستند.

مغز حتی از بهترین شبکههای عصبی مصنوعی که ما توسعه دادهایم بسیار برتر است، اما واقعاً نمیدانیم مغز چگونه کار میکند. تفکر در مورد ارتباط بین سخت افزار بیولوژیکی و شبکه های هوش مصنوعی در مقیاس بزرگ ارزش علمی دارد. دیمیتری کروتوف، یکی از کارکنان تحقیقاتی آزمایشگاه هوش مصنوعی واتسون MIT-IBM و نویسنده ارشد مقاله تحقیقاتی میگوید: «این علم اعصاب برای هوش مصنوعی و هوش مصنوعی برای علوم اعصاب است.

نویسنده اصلی لئو کوزاچکوف، یک فوق دکترا در بخش مغز و علوم شناختی MIT، به کروتوف در این مقاله میپیوندند. و Ksenia V. Kastanenka، استادیار نوروبیولوژی در دانشکده پزشکی هاروارد و دستیار محقق در موسسه تحقیقات عمومی ماساچوست.

یک عدم امکان زیستی قابل قبول می شود

ترانسفورماتورها متفاوت از سایر مدل های شبکه عصبی عمل می کنند. به عنوان مثال، یک شبکه عصبی تکراری که برای پردازش زبان طبیعی آموزش داده شده است، هر کلمه را در یک جمله با یک حالت داخلی که توسط کلمات قبلی تعیین شده است مقایسه می کند. از سوی دیگر، یک ترانسفورماتور تمام کلمات جمله را به طور همزمان با هم مقایسه می کند تا یک پیش بینی ایجاد کند، فرآیندی به نام توجه به خود.

کروتوف توضیح میدهد که برای اینکه توجه به خود کار کند، ترانسفورماتور باید تمام کلمات را به شکلی از حافظه آماده نگه دارد، اما این امر از نظر بیولوژیکی به دلیل نحوه ارتباط نورونها ممکن به نظر نمیرسید.

با این حال، چند سال پیش، دانشمندانی که نوع کمی متفاوت از مدل یادگیری ماشینی (معروف به حافظه مرتبط متراکم) را مطالعه می کردند، متوجه شدند که این مکانیسم خودتوجهی می تواند در مغز اتفاق بیفتد، اما تنها در صورتی که بین حداقل سه نورون ارتباط وجود داشته باشد.

کوزاچکوف میگوید: «عدد سه واقعاً برای من ظاهر شد، زیرا در علوم اعصاب شناخته شده است که این سلولها به نام آستروسیتها، که نورون نیستند، اتصالات سهطرفهای با نورونها ایجاد میکنند که سیناپسهای سهجانبه نامیده میشوند.

هنگامی که دو نورون با هم ارتباط برقرار می کنند، یک نورون پیش سیناپسی مواد شیمیایی به نام انتقال دهنده های عصبی را در سراسر سیناپس می فرستد که آن را به یک نورون پس سیناپسی متصل می کند. گاهی اوقات، یک آستروسیت نیز به هم متصل می شود – شاخک بلند و نازکی را به دور سیناپس می پیچد و یک سیناپس سه جانبه (سه قسمتی) ایجاد می کند. یک آستروسیت ممکن است میلیون ها سیناپس سه جانبه را تشکیل دهد.

آستروسیت برخی از انتقال دهنده های عصبی را جمع آوری می کند که از طریق اتصال سیناپسی جریان دارند. در برخی موارد، آستروسیت می تواند به نورون ها سیگنال دهد. از آنجایی که آستروسیتها در مقیاس زمانی بسیار طولانیتری نسبت به نورونها عمل میکنند – آنها سیگنالهایی را با بالا بردن آرام پاسخ کلسیم خود و سپس کاهش آن ایجاد میکنند – این سلولها میتوانند اطلاعاتی را که از نورونها به آنها ارسال میشود، نگه داشته و یکپارچه کنند. کروتوف می گوید به این ترتیب آستروسیت ها می توانند نوعی بافر حافظه را تشکیل دهند.

او می افزاید: «اگر از این منظر به آن فکر کنید، آستروسیت ها دقیقاً برای محاسباتی که ما برای انجام عملیات توجه در داخل ترانسفورماتورها نیاز داریم، بسیار طبیعی هستند.

ساخت شبکه نورون-آستروسیت

با این بینش، محققان فرضیه خود را مبنی بر اینکه آستروسیت ها می توانند در نحوه محاسبه ترانسفورماتورها نقش داشته باشند، شکل دادند. سپس آنها شروع به ساخت یک مدل ریاضی از شبکه نورون-آستروسیت کردند که مانند یک ترانسفورماتور عمل می کند.

آنها ریاضیات اصلی را که شامل یک ترانسفورماتور است، انتخاب کردند و مدلهای بیوفیزیکی سادهای از آنچه آستروسیتها و نورونها در هنگام ارتباط در مغز انجام میدهند، بر اساس یک فرو رفتن عمیق در ادبیات و راهنمایی همکاران عصبشناس توسعه دادند.

سپس مدلها را به روشهای خاصی ترکیب کردند تا اینکه به معادلهای از شبکه نورون-آستروسیت رسیدند که توجه یک ترانسفورماتور را به خود توصیف میکند.

«گاهی اوقات، متوجه میشدیم که چیزهایی که میخواستیم درست باشند، قابل اجرا نیستند. بنابراین، ما باید به راهحلهایی فکر میکردیم. برخی چیزها در مقاله وجود دارد که تقریب بسیار دقیقی از معماری ترانسفورماتور است تا بتوان آن را به روشی قابل قبول بیولوژیکی مطابقت داد.» کوزاچکوف می گوید.

از طریق تجزیه و تحلیل خود، محققان نشان دادند که شبکه بیوفیزیکی نورون-آستروسیت آنها از نظر تئوری با یک ترانسفورماتور مطابقت دارد. علاوه بر این، آنها شبیهسازیهای عددی را با تغذیه تصاویر و پاراگرافهای متن به مدلهای ترانسفورماتور و مقایسه پاسخها با پاسخهای شبکه نورون-آستروسیت شبیهسازی شده خود انجام دادند. هر دو به روش های مشابه به درخواست ها پاسخ دادند و مدل نظری خود را تأیید کردند.

آستروسیتها پس از گذشت بیش از یک قرن از ضبطهای مغزی، از نظر الکتریکی خاموش ماندهاند، یکی از فراوانترین و در عین حال کمتر کشفشدهترین سلولها در مغز هستند. کنستانتینوس میخمیزوس، دانشیار علوم کامپیوتر در دانشگاه راتگرز، که در این کار دخالتی نداشت، میگوید پتانسیل آزاد کردن قدرت محاسباتی نیمه دیگر مغز ما بسیار زیاد است. “این مطالعه یک حلقه تکراری جذاب را باز می کند، از درک چگونگی ظهور رفتار هوشمندانه در مغز تا تبدیل فرضیه های مخرب به ابزارهای جدیدی که هوشی شبیه انسان را نشان می دهند.”

گام بعدی محققین جهش از نظریه به عمل است. آنها امیدوارند پیشبینیهای مدل را با پیشبینیهایی که در آزمایشهای بیولوژیکی مشاهده شده است مقایسه کنند و از این دانش برای اصلاح یا احتمالاً رد فرضیهشان استفاده کنند.

علاوه بر این، یکی از مفاهیم مطالعه آنها این است که آستروسیت ها ممکن است در حافظه بلندمدت دخیل باشند، زیرا شبکه باید اطلاعات را ذخیره کند تا بتواند در آینده بر روی آن عمل کند. کروتوف می گوید که تحقیقات بیشتر می تواند این ایده را بیشتر مورد بررسی قرار دهد.

به دلایل زیادی، آستروسیت ها برای شناخت و رفتار بسیار مهم هستند و به روش های اساسی متفاوت از نورون ها عمل می کنند. بزرگترین امید من برای این مقاله این است که مجموعهای از تحقیقات در علوم اعصاب محاسباتی را در مورد سلولهای گلیال و بهویژه آستروسیتها کاتالیز کند.»

این تحقیق تا حدی توسط بنیاد BrightFocus و موسسه ملی بهداشت پشتیبانی شد.